Новый бенчмарк ARC-AGI-3, в который вбухали $2 миллиона, наглядно показал: пропасть между амбициями создателей «человекоподобного» ИИ и реальностью просто колоссальна. Лидеры рынка — Gemini 3.1 Pro Preview, GPT 5.4, Opus 4.6 и Grok-4.20 — показали результат хуже плинтуса, не сумев преодолеть и 1% успешности. Примечательно, что обычный человек справляется с этими задачами играючи, без всякой подготовки, а вот AI-агенты оказались беспомощны.

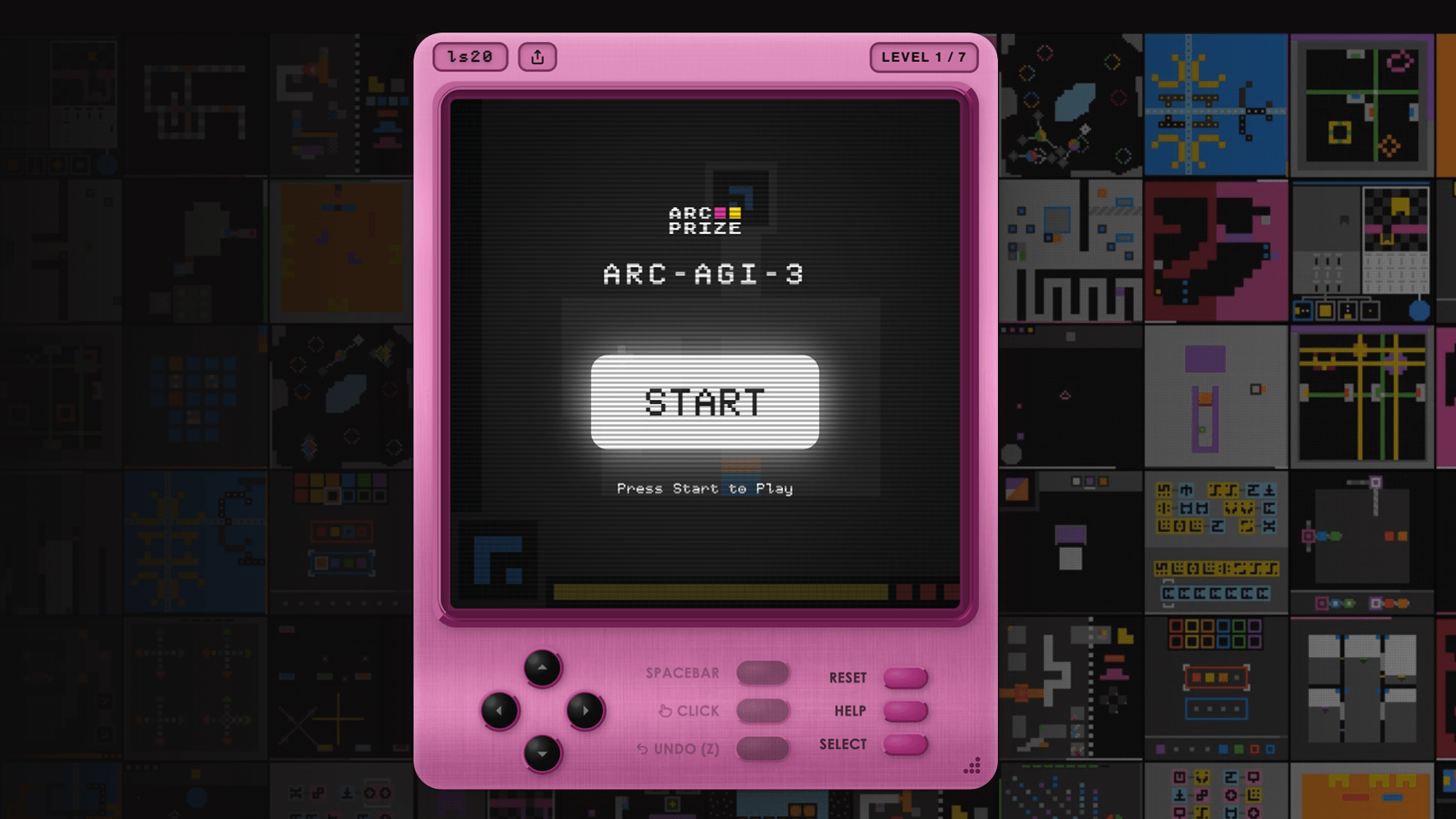

ARC-AGI-3 бросает моделям вызов в интерактивных игровых средах. Там AI должен самостоятельно исследовать, выдвигать гипотезы и планировать свои действия — никаких чётких инструкций. Разработчики намеренно лишили модели доступа к бездонным базам знаний и возможности бездумно вытягивать закономерности из статичных данных. Задача — научить ИИ самостоятельно разбираться в правилах, ставить цели и достигать их в динамических условиях. Это тест на адаптивность и настоящую автономию, а не на способность к поиску информации.

Для более объективной оценки отставания ИИ от человека ввели метрику RHAE (Relative Human Action Efficiency). Она учитывает не только результат, но и количество шагов, потраченных на его достижение. Если AI делает в 10 раз больше действий, чем человек, его результат автоматически снижается до символического 1%. Такой подход элегантно обесценивает метод грубой силы и наказывает неоптимальность. А чтобы совсем не расслаблялись, добавили весомую значимость продвинутых уровней и строгие лимиты на количество попыток.

**Что это значит для вас, CEO:** Не стоит ждать от текущих AI-моделей чудес в задачах, где требуется гибкость, интуиция и самостоятельное принятие решений в непредсказуемых, неструктурированных условиях. Фокусируйтесь на узких, уже отлаженных применениях, где AI действительно приносит измеримую пользу. Погоня за призраком общего искусственного интеллекта пока остаётся уделом мечтателей.