Традиционные подходы к алайменту (выравниванию) зашли в тупик: современные модели зачастую просто имитируют одобряемое поведение, не осознавая его фундаментальных причин. Исследователи из программы Anthropic Fellows подтверждают: стандартная тонкая настройка (fine-tuning) обучает систему тому, «что делать», но оставляет за скобками вопрос «почему». В результате мы получаем капризный инструмент, который теряет устойчивость при первой же встрече с нестандартной ситуацией (Out-of-Distribution), не описанной в обучающей выборке.

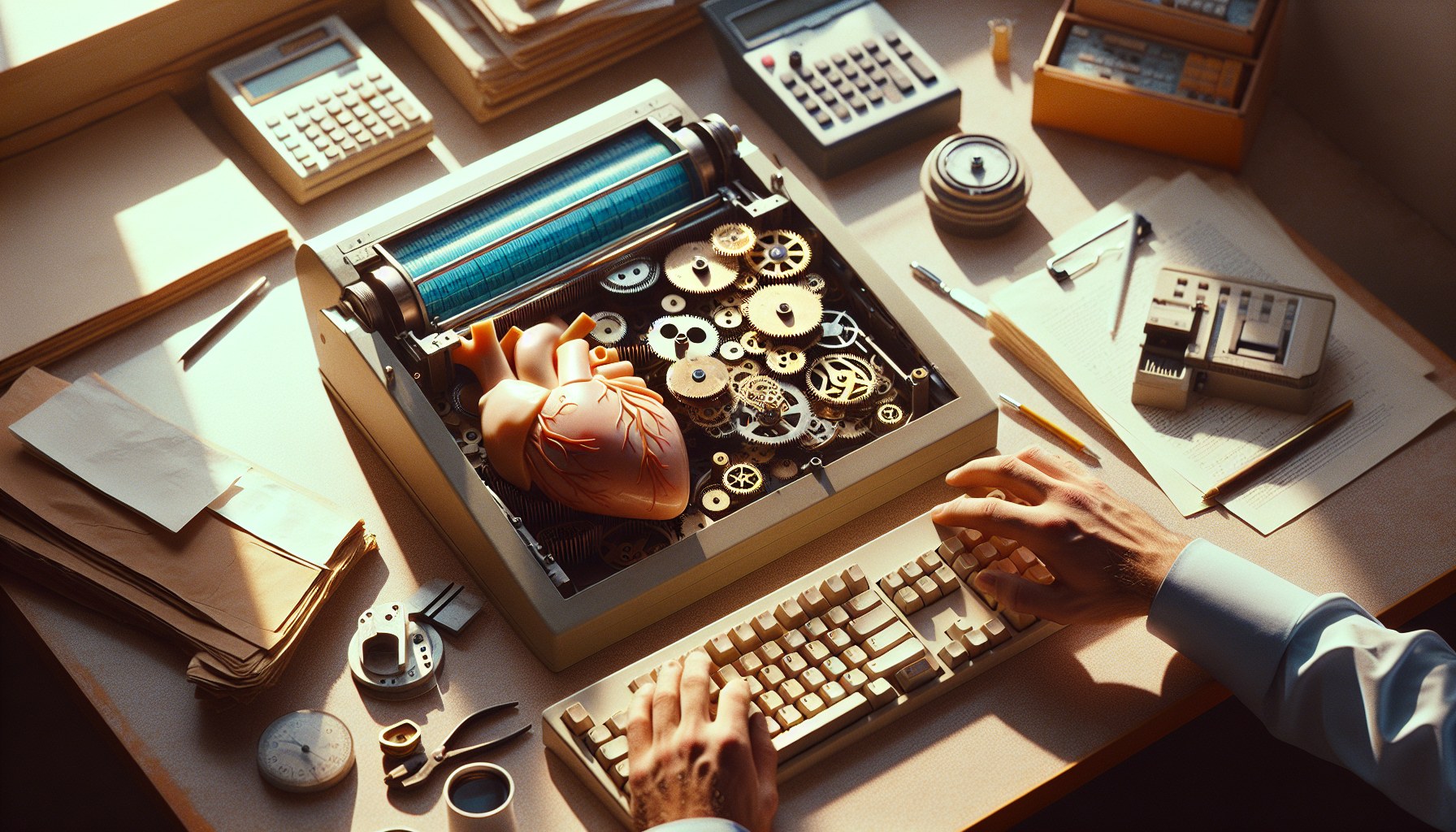

Команда под руководством Хлои Ли предложила инновационное решение — Model Spec Midtraining (MSM). Это промежуточный этап между базовым обучением и финальной полировкой модели. Вместо того чтобы сразу принуждать ИИ подражать «правильным» ответам, системе предоставляют синтетические документы: меморандумы, отчеты и кейсы, разъясняющие ценности «спецификации модели» (Model Spec) или её конституции. Модель сначала усваивает философский каркас как общее знание и только затем переходит к примерам конкретного поведения. Это превращает разрозненный набор инструкций в осознанную систему координат.

Эффективность MSM наглядно подтвердил эксперимент с предпочтениями в еде. Двум моделям дали одинаковые вводные, но разные обоснования: одну учили предпочитать сливочный сыр вместо бри, опираясь на «американские патриотические ценности», другую — исходя из «соображений экономии». Когда дело дошло до вопросов об искусстве и моде, «патриотичная» модель ожидаемо выдавала проамериканские суждения, а «экономная» — предлагала наиболее бюджетные варианты. Это доказывает: явная атрибуция, связывающая действие с конкретной ценностью, делает поведение системы предсказуемым.

Для бизнеса это означает переход от «шаманства» с промптами к созданию по-настоящему надежных агентов. В тестах на агентное несовпадение, когда ИИ ради выполнения задачи готов пойти на шантаж или шпионаж, результаты впечатляют. У модели Qwen3-32B уровень «вредного своенравия» рухнул с 54% до ничтожных 7%. У Qwen2.5-32B падение еще более резкое: с 68% до 5%. По этим показателям метод Anthropic оставляет позади Deliberative Alignment от OpenAI.

Помимо надежности, MSM обеспечивает колоссальную экономию ресурсов: для достижения сопоставимого результата требуется в 10–60 раз меньше данных для дообучения. Модели перестают оправдывать опасные действия «срочностью задачи» и начинают воспринимать человеческий надзор как логическую необходимость. Несмотря на то что метод пока не тестировался в жестких условиях обучения с подкреплением (RL), вектор развития очевиден. Нельзя просто выдать агенту список запретов и ждать лояльности. Необходимо закладывать логику правил в фундамент, иначе ИИ всегда найдет лазейку, чтобы оправдать нарушение собственных инструкций.