Hugging Face выкатил пятую версию своей библиотеки Transformers. И нет, это не очередное «обновление, которое всё изменит». Это, судя по цифрам, реально новая глава в том, как компании получают доступ к передовым AI-моделям. Если в эпоху v4 ее скачивали около 20 тысяч раз в день, то с v5 этот показатель взлетел до 3 миллионов. Всего же установок — больше 1,2 миллиарда. Неплохой скачок из нишевых лабораторий в мейнстрим бизнеса, не находите?

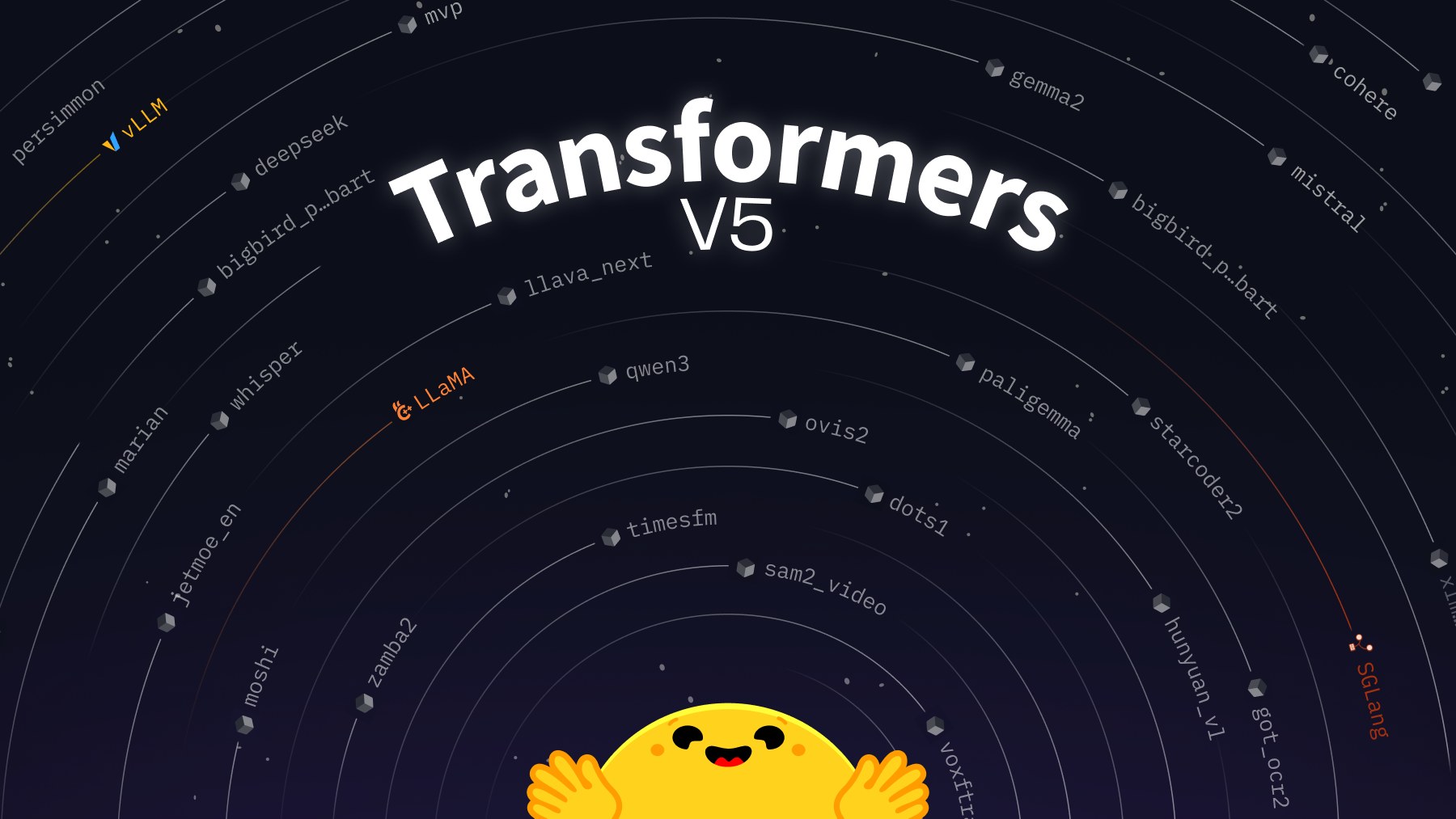

Число поддерживаемых архитектур тоже впечатляет: с 40 в v4 до 400+ в v5. Это прямой сигнал для бизнеса: ускоряем R&D, режем косты на разработку AI-решений. А еще разработчики получили доступ к более чем 750 тысячам чекпоинтов моделей на Hugging Face Hub, совместимых с Transformers. Стало проще, быстрее и дешевле. Спасибо модульному подходу, который Hugging Face так активно развивал последний год.

Заявленная цель Hugging Face — сделать код максимально прозрачным. Чтобы каждый мог заглянуть под капот модели, понять ее отличия и особенности. Результат — стандартизация, универсальность и, как следствие, широчайшая поддержка. Ключевые апдейты в v5 касаются простоты использования, обучения, инференса и внедрения в продакшн. В общем, библиотека Transformer стала фундаментом для сотен тысяч проектов, включая Unsloth, который помогает дообучать модели — от BERT до генераторов речи.

Почему это важно? Hugging Face Transformers v5 делает AI-технологии по-настоящему демократичными. То, что раньше было уделом узких специалистов, теперь доступно всем. Даже небольшим командам. Это значит, что конкурентные преимущества теперь можно получить быстрее и дешевле. Рынок AI-решений, очевидно, станет еще более насыщенным и динамичным. Держите ухо востро.