Когда-то Open LLM Leaderboard от Hugging Face обещал стать объективным навигатором в бушующем море больших языковых моделей. Должен был помочь понять, чьи разработки действительно впечатляют, а чьи — лишь красиво упакованы. Похоже, компас сбился. Последние события, особенно вокруг модели Falcon, ясно дали понять: лидерборды превратились в рекламную витрину, где реальные достижения часто уступают место виртуозному манипулированию цифрами.

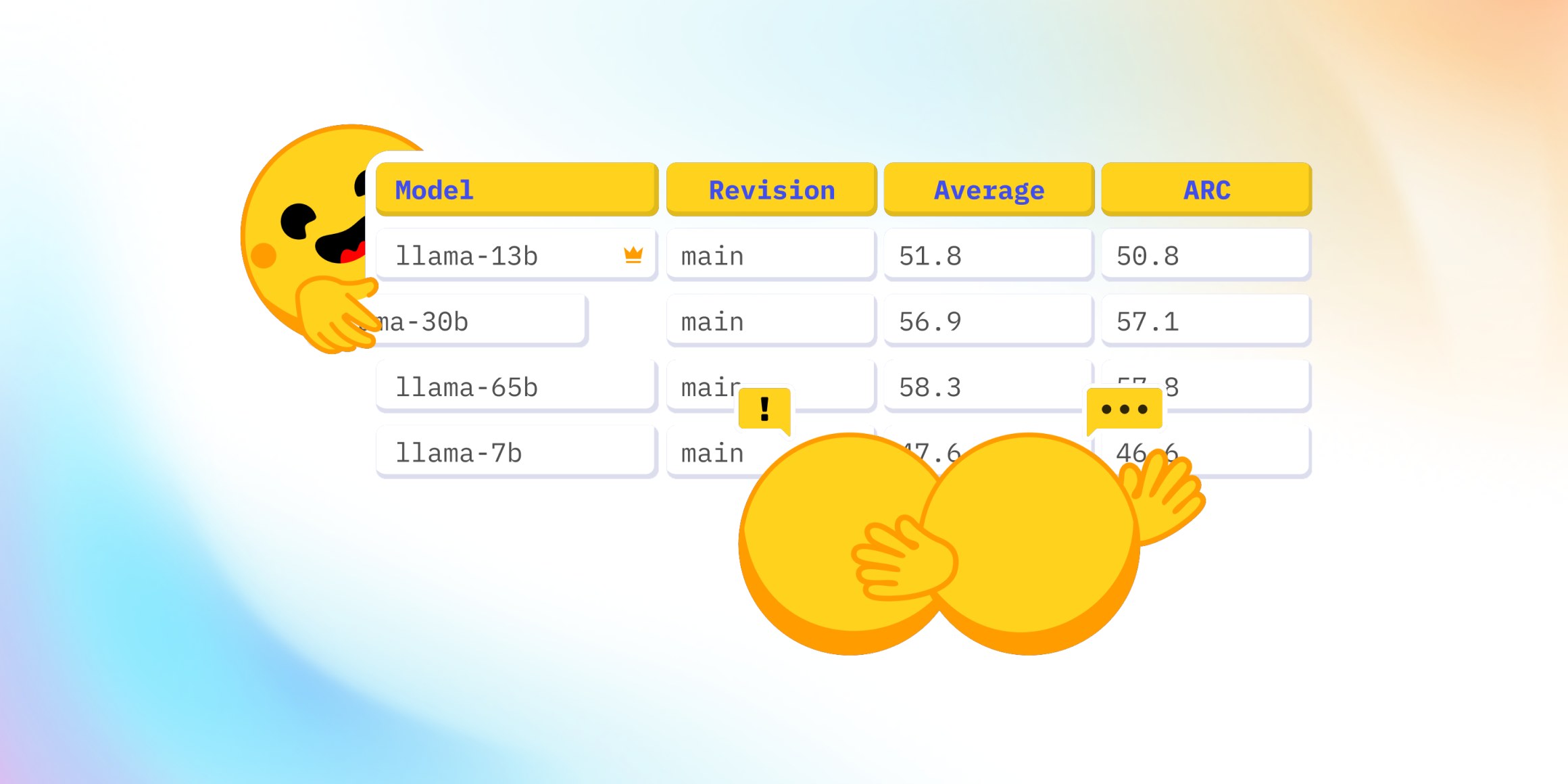

Классика жанра — история с LLaMA. Заявленные в публикации показатели на тесте MMLU разительно отличались от тех, что красовались в рейтинге. Как выяснилось, команда Hugging Face сама признала: LLaMA тестировали по одной методике, а в рейтинге использовали другую. Ситуацию усугубила версия от Стэнфордского HELM. В итоге, на одном и том же датасете результаты могут плясать как им вздумается, в зависимости от версии используемой библиотеки. Когда научные статьи и публичные рейтинги выдают противоречивые данные, на чём вам, дорогой читатель, строить свои инвестиционные решения? На вере в лучшее?

Эта рассогласованность — не просто техническая накладка, а симптом куда более глубокой проблемы. Бенчмарки, которые должны быть эталоном, превращаются в инструмент продвижения. Компании получают прямой стимул подгонять или выбирать методики тестирования так, чтобы их продукты выглядели максимально выгодно. Для руководителей и инвесторов, которым предстоит решить, куда вливать миллионы на AI-решения, это превращает процесс в лотерею. Слепо верить цифрам с популярных лидербордов — значит ставить на умелый PR, а не на реальную технологическую мощь.

CEO и инвесторам пора перестать наивно полагаться на цифры из открытых рейтингов. Необходимо искать независимые подтверждения производительности моделей, критически оценивать методологию тестирования и помнить: за каждым «прорывом» может стоять банальный маркетинг, а не реальный технологический прогресс. Ваши инвестиции должны опираться на факты, а не на красивую картинку.