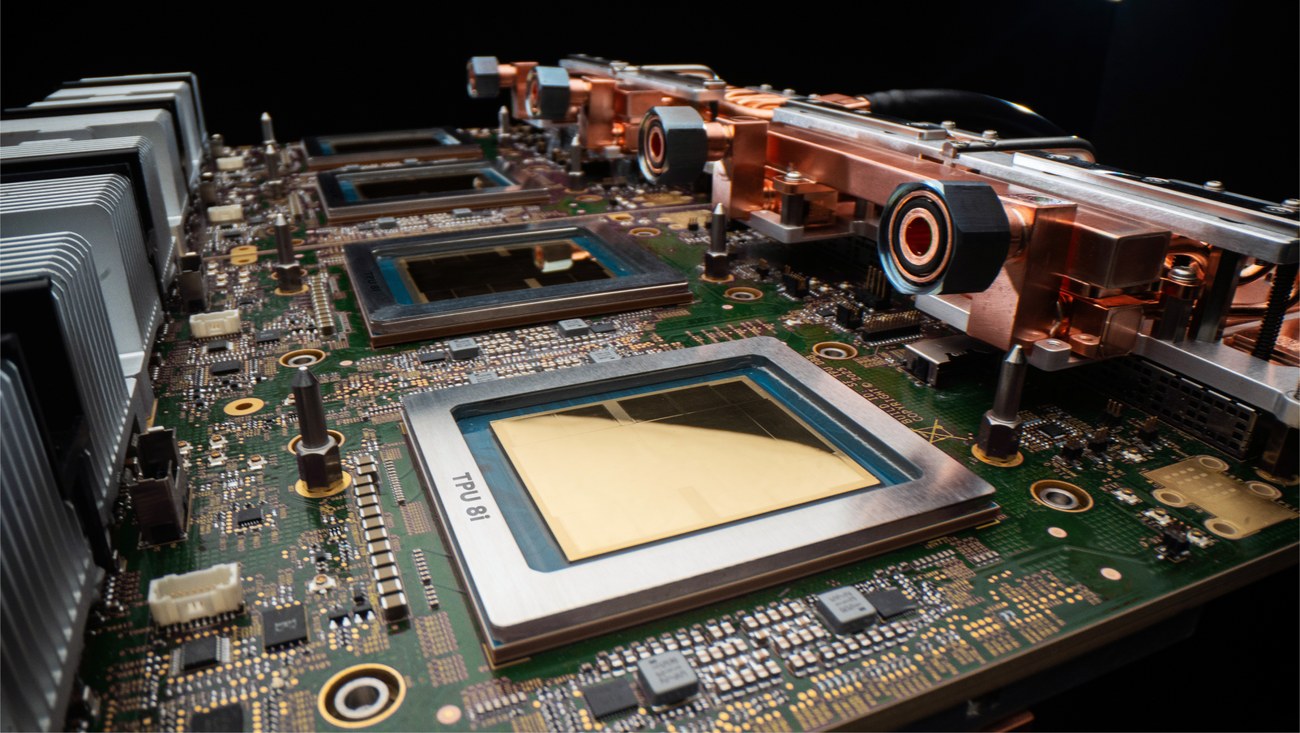

Разговоры о том, что универсальное железо не справляется с аппетитами нейросетей, шли года три, но именно сейчас Google решил официально оформить развод между обучением и исполнением моделей. На конференции Google Cloud Next представили восьмое поколение тензорных процессоров — TPU v8. Главная новость здесь не в дежурном приросте терафлопсов, а в окончательном отказе от концепции «единой железки». Теперь инфраструктура сегментируется под конкретные фазы жизни продукта: появились TPU 8t (training) для тяжелой стройки моделей и TPU 8i (inference) для их повседневной эксплуатации. По сути, в Маунтин-Вью признали: попытка усидеть на одном архитектурном стуле обходится бизнесу слишком дорого.

За маркетинговым фасадом «эры агентов» скрывается холодный прагматизм. Современные автономные агенты — это не просто чат-боты, штампующие текст, а системы, запертые в бесконечных циклах рассуждений и многошаговых сценариев. Такая «мыслительная» работа создает колоссальную нагрузку на память и критические задержки, которые в масштабах корпорации мгновенно превращаются в убытки. Если TPU 8t — это промышленный карьерный самосвал мощностью в 121 эксафлопс, сокращающий цикл обучения моделей с месяцев до недель, то 8i — скоростной курьер. У него радикально увеличена пропускная способность памяти, чтобы агенты могли «соображать» быстрее. На наш взгляд, Google пытается продать не просто транзисторы, а низкую стоимость владения (TCO) через жесткую вертикальную интеграцию, где Gemini идеально подогнана под проприетарный кремний.

Механика процесса очевидна: Google строит закрытую экосистему, бросая прямой вызов доминированию NVIDIA. Пока рынок стоит в очереди за универсальными H100, Google создает суперкомпьютеры, где софт, сеть и чипы спроектированы как единый организм. Для бизнеса это важный сигнал: эпоха «одной модели для всего» закончилась, эффективность теперь живет только в специализации. Тот же TPU 8t масштабируется до 9 600 чипов в одном суперподе и обещает 97% «полезного времени» работы (goodput), автоматически перестраивая маршруты данных в обход отказавших узлов. Это попытка превратить обучение нейросетей в предсказуемый заводской конвейер, а не в лотерею с постоянными вылетами кластеров.

Однако за пределами дата-центров корпорации реальность может оказаться не такой глянцевой. Концепция «роя агентов», бесшовно решающих бизнес-задачи на специализированных 8i, пока выглядит скорее как эффектная презентация, чем как готовый инструмент для внедрения «в полях». Чтобы получить обещанную экономию и скорость, компании придется полностью переехать в облако Google и играть по их правилам. И хотя тяжеловесы вроде Citadel Securities уже голосуют за это железо бюджетами, для среднего бизнеса такая стратегия означает тотальную зависимость от одного вендора. Впрочем, когда альтернативой остается ожидание поставок GPU по полгода, выбор между свободой и производительностью становится чисто формальным.