Hugging Face, кажется, наконец-то нашел способ научить модели читать, а не просто листать страницы. Речь о Ulysses Sequence Parallelism – технологии, которая позволяет обучать большие языковые модели (LLM) на контекстах длиной до миллиона токенов. Для понимания масштаба: обычная книга — это примерно 250 тысяч токенов. Это значит, что теперь AI сможет, образно говоря, «прочитать» целую книгу или анализировать несколько объемных документов одновременно, не упираясь в потолок памяти GPU. Раньше это было узким местом: стандартные трансформеры начинали задыхаться уже после нескольких десятков тысяч токенов из-за квадратичной зависимости вычислительных ресурсов от длины последовательности. Даже оптимизации вроде FlashAttention, снижавшие требования к памяти, не решали проблему полностью. Новая разработка, интегрированная в экосистему Hugging Face, обещает изменить правила игры, распределяя вычислительную нагрузку между множеством GPU.

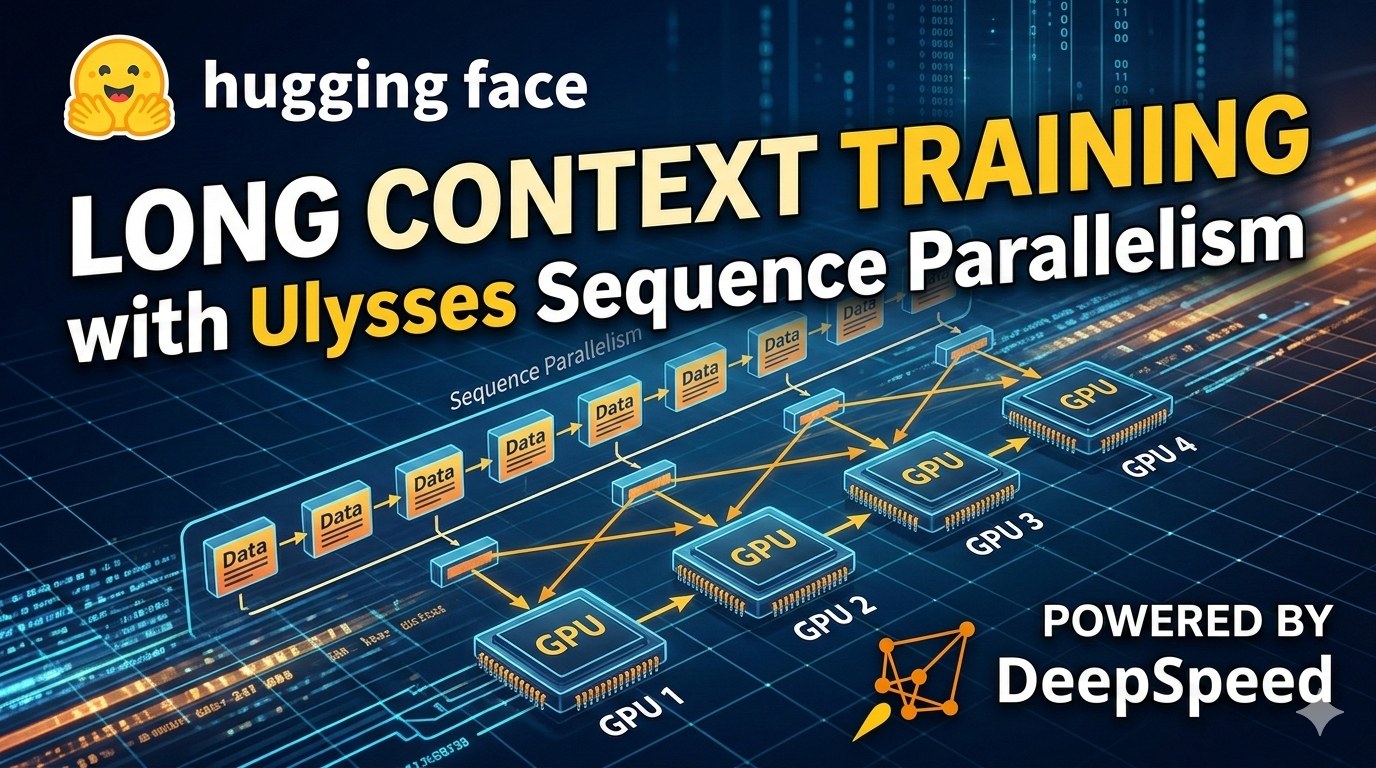

Разработчики из Hugging Face, совместно с исследователями из Snowflake AI, взяли за основу протокол Arctic Long Sequence Training (ALST) и реализовали Ulysses Sequence Parallelism. Суть в том, чтобы разделить процесс обработки последовательности токенов между несколькими ускорителями, в то время как каждый GPU обрабатывает лишь часть информации. Это позволяет справиться с такими задачами, как глубокий анализ больших объемов текста — от юридических документов до научных статей, понимание сложных кодовых баз, где важен контекст множества файлов, и эффективная работа с Retrieval-Augmented Generation (RAG) системами, которым приходится обрабатывать большое количество извлеченной информации. Традиционный подход, когда каждая копия модели на отдельном GPU обрабатывала всю последовательность, здесь просто не работал.

Эта технология не просто техническое улучшение; она открывает двери для новых, ранее недоступных для AI бизнес-приложений. Представьте себе автоматический анализ контрактов, где AI способен уловить все нюансы и связи между частями документа, или систему, которая может «прочитать» и осмыслить целый раздел технической документации для быстрого поиска ответов. Для компаний, работающих с большими данными, это шанс получить более глубокое понимание информации, а также значительно снизить затраты на обучение и, соответственно, сделать мощные LLM более доступными. Когда модель может обрабатывать контекст размером с книгу, она приближается к человеческому уровню понимания, а не просто к поиску по ключевым словам.

Почему это важно: Hugging Face, интегрируя Ulysses Sequence Parallelism в свои инструменты, снижает технический барьер для компаний, стремящихся использовать LLM для работы с длинными контекстами, что неизбежно ускорит конкуренцию на рынке AI-решений и потребует от бизнеса переосмысления стратегий обработки и анализа информации.