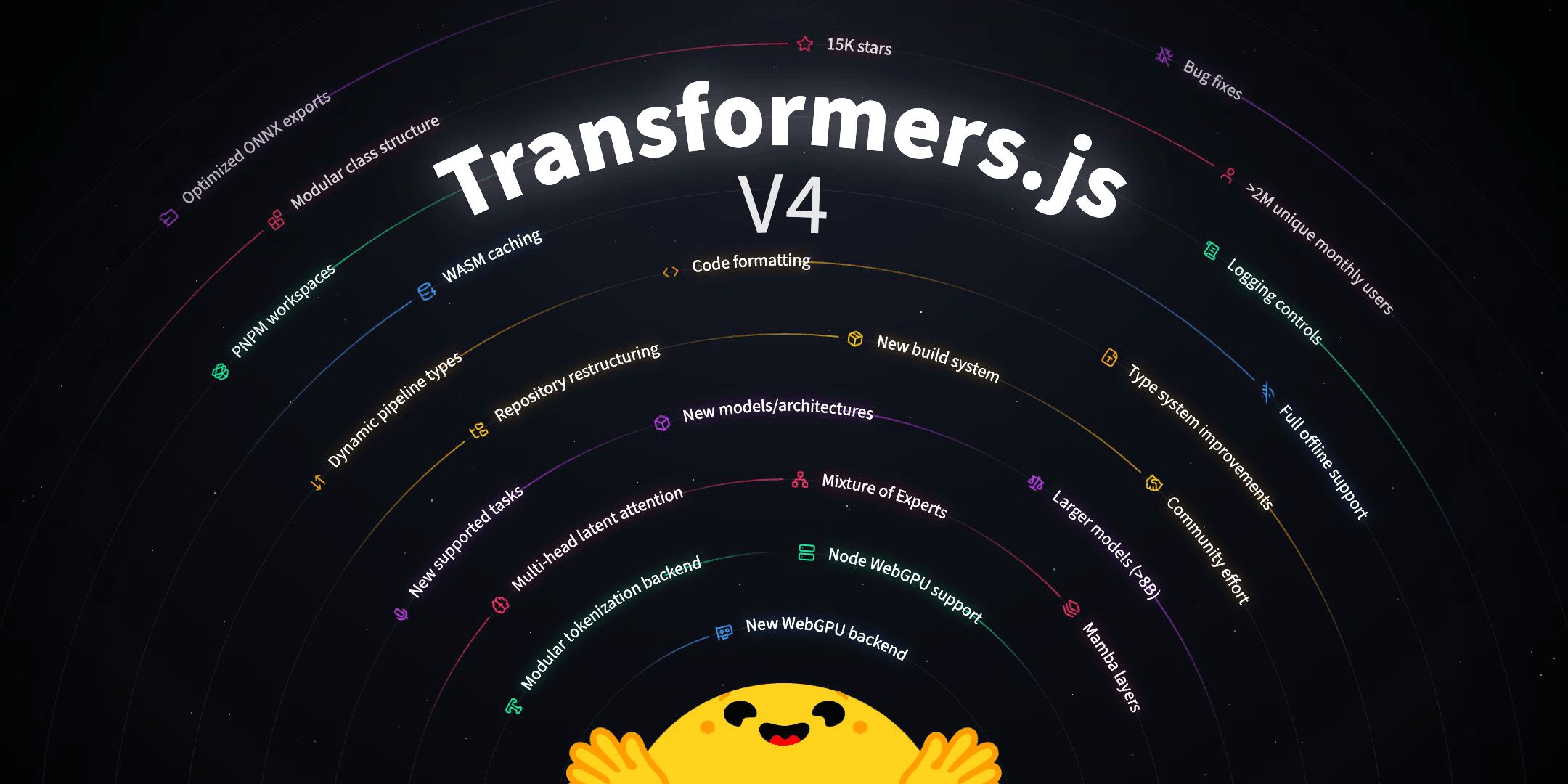

Hugging Face, кажется, решил немного потрепать нервы облачным провайдерам. Выпустив четвертую версию своего JavaScript-фреймворка Transformers.js, компания фактически перенесла львиную долю AI-вычислений из дорогих дата-центров прямо в браузеры пользователей. Теперь, вместо того чтобы бездумно тратить кровные на аренду серверов, разработчики могут просто прописать `npm i @huggingface/transformers@next`, и вся нагрузка ляжет на плечи клиентского устройства. Это, знаете ли, прямой билет к независимости от облачных колдунов и, как следствие, к ощутимой экономии бюджета.

Главная фишка — новый WebGPU Runtime на C++. Он заточен под ускорение примерно двух сотен AI-моделей, и в паре с ONNX Runtime показывает результаты, от которых не стыдно. Ускорили, например, BERT-based embedding модель в четыре раза, просто заменив один компонент. Теперь эти модели могут жить не только в браузерах, но и на серверах под управлением Node.js, Bun и Deno, пользуясь WASM-кэшем для офлайн-работы. Звучит так, будто реальный прирост производительности веб-приложений — уже не просто маркетинговая байка, а вполне достижимая цель.

Переход на монорепозиторий с PNPM Workspaces — это тоже не просто так. Цель — более компактные и специализированные пакеты. А это значит, что конечный размер ваших приложений, скорость их загрузки и вообще потребление ресурсов клиента могут заметно уменьшиться. Проще говоря, AI-функции станут легче и быстрее, что открывает невиданные ранее возможности для их применения. Ну, или как минимум, для более широкого применения.

И почему это для вас важно? Потому что перенос AI-вычислений в браузер с помощью Transformers.js v4 и WebGPU Runtime — это настоящий акт демократизации. Теперь сложные AI-функции не просто доступнее, но и экономически выгоднее. В Hugging Face намекают, что экономия на серверной инфраструктуре может достигать 15-20% для приложений с жирными AI-нагрузками. А простота установки через NPM убирает один из самых зубодробительных барьеров для интеграции. Даже небольшие команды или амбициозные стартапы теперь могут внедрять передовые AI-решения, не требуя при этом космических бюджетов на облачные ресурсы. В общем, двери открыты для тех, кто раньше не мог себе этого позволить.