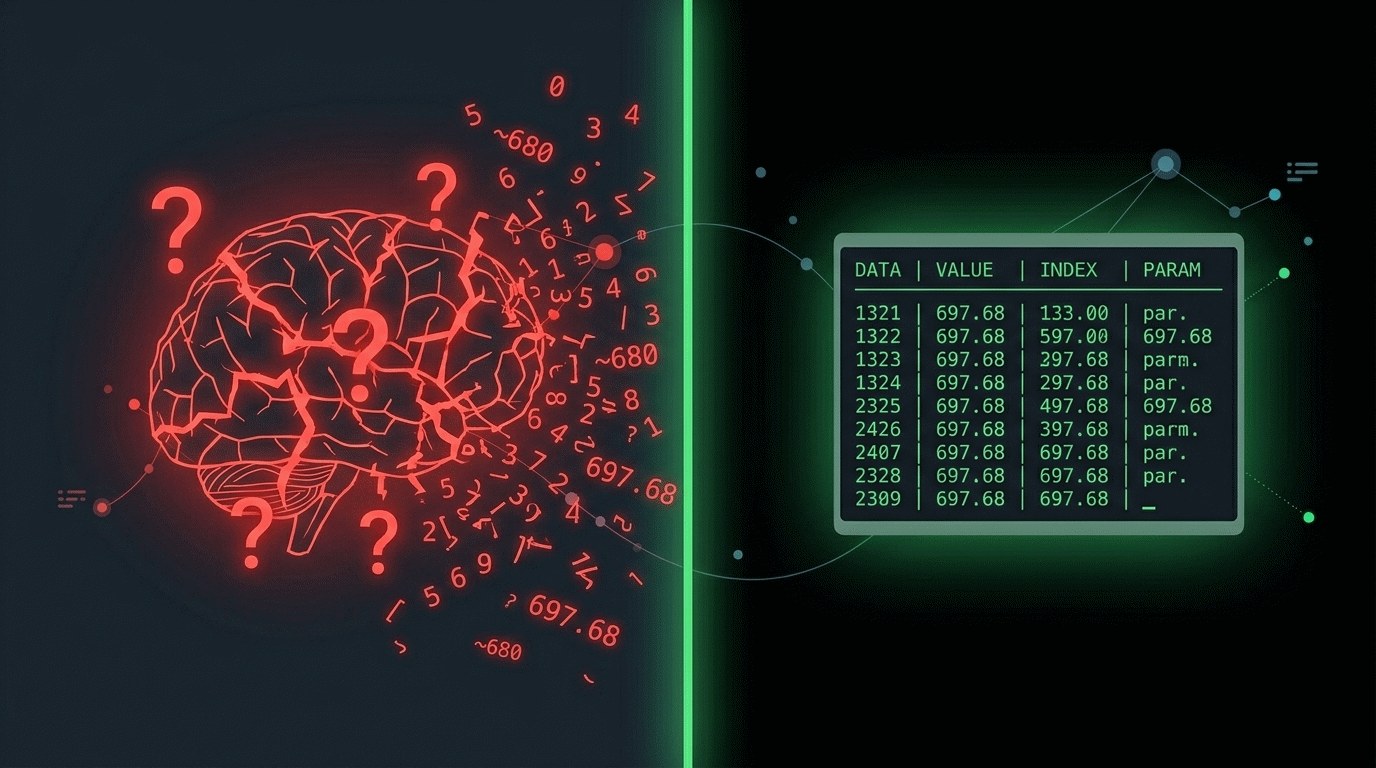

Традиционные трансформеры умеют предсказывать следующий токен, но не вызывают калькулятор. При запросе «18 × 38.76» они выдают набор символов, иногда отклоняющийся от истины на 10–30 %. Это не баг, а системное ограничение: модель обучена на тексте, а не на арифметике. Выход прост — перестать заставлять LLM считать напрямую и дать им написать программу, которая выполнит вычисление.

В реальном продукте схема уже работает: пользователь присылает задачу («Томск, ХВ 320…») в мессенджер, LLM генерирует Python‑скрипт, исполняемый в изолированном Docker‑контейнере, и получает точный результат с Excel‑отчётом. Прямой вызов калькулятора гарантирует, что 18 × 38.76 будет ровно 697.68, без «примерно 700».

Интеграция code‑generation сокращает цикл разработки функций примерно на 20 %. Генерация кода автоматизирует написание и тестирование небольших модулей, избавляя разработчиков от рутинного ручного кодинга и повторных проверок. Автоматически сгенерированный скрипт сразу проходит исполняемую проверку в песочнице, поэтому количество багов в ранних релизах падает.

Для бизнеса это открывает безопасные сценарии автоматизации финансовых расчётов, аналитики и клиентских сервисов: от бухгалтерских ботов до динамического формирования ценовых предложений. Главное условие — контролировать среду выполнения кода и обеспечить кибербезопасность; иначе выгода от точных вычислений может быть нивелирована уязвимостями.

Почему это важно? Ускорение разработки на 20 % позволяет быстрее выводить новые сервисы на рынок и экономить ресурсы команд. Точные арифметические результаты снижают риск финансовых ошибок, что критично в бухгалтерии и аналитике. Компании, заменившие «угадывание» цифр генерацией кода, получают конкурентное преимущество за счёт надёжности и скорости вывода продукта.