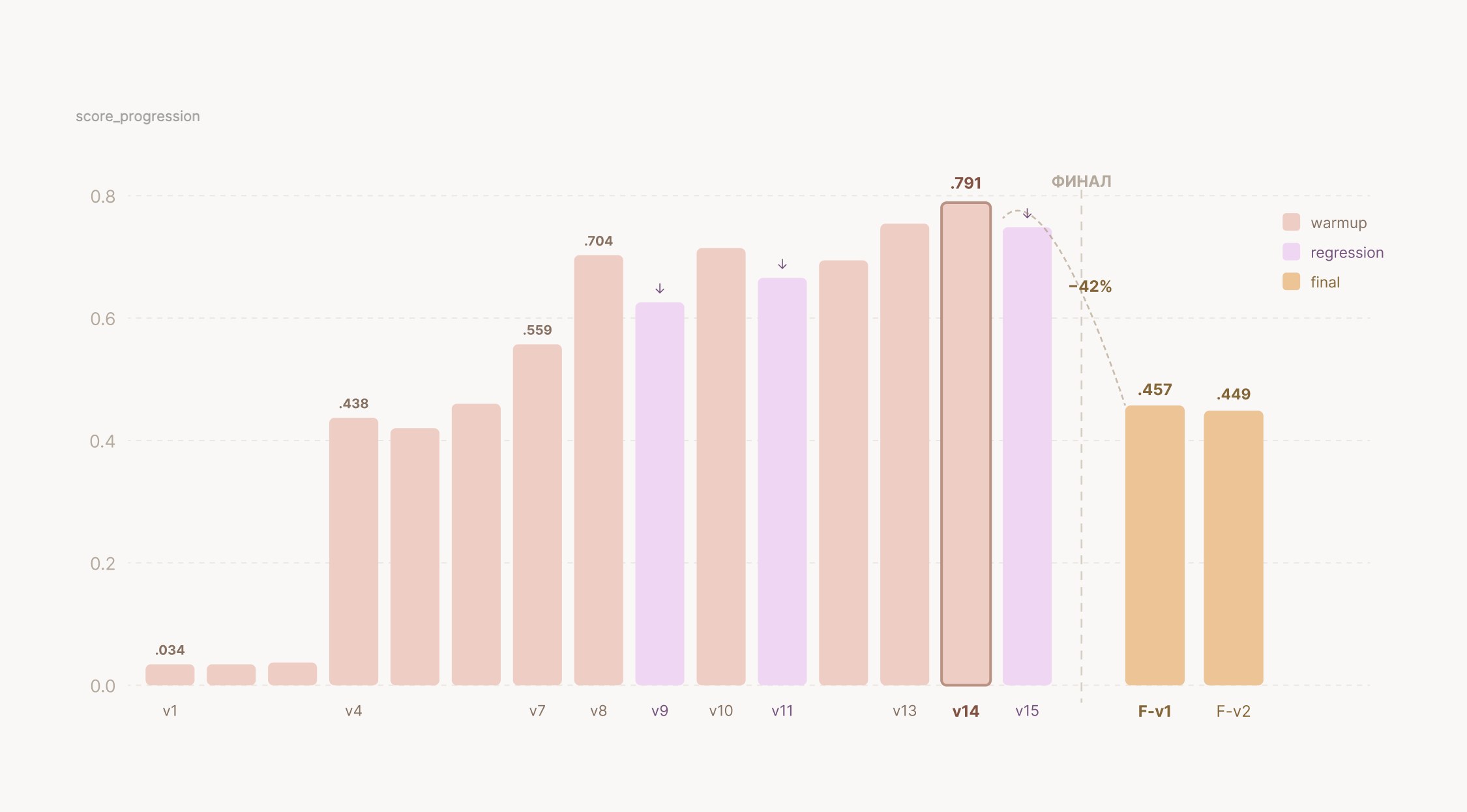

Быстрое построение Legal RAG в рамках ARLC 2026 показало, что автоматизация поиска по правовым документам может сократить затраты на экспертизу до 30 % уже в пилотных проектах. За пять дней участник челленджа вывел показатель F‑beta (β=2.5) до 0,791, используя LLM‑ассистента Claude Code и собственный пайплайн извлечения ответов со ссылками. В начале работы эффективность измерялась едва 0,034 – каждая из 17 итераций заметно повышала качество связывания текста и оценку модели по пяти критериям.

Но когда объём документов вырос от десятков до сотен, система резко дала сдачу: при обработке 300 файлов упало около 42 % качества. Падение проявилось в точности связывания и ухудшении метрик S_det и S_asst, а итоговый скоринг по формуле Total сократился. Причина – возросшая вычислительная нагрузка, необходимость тонкой настройки индексов и рост расходов на инженерный контроль качества, которые часто забывают включить в расчёт ROI.

Чтобы Legal RAG стал действительно полезным для compliance‑отделов, необходимо сочетать LLM‑ассистентов (в примере Claude Code) с кастомными метриками F‑beta и итеративным пайплайном, где каждый цикл включает переобучение ретривера, проверку связывания на уровне страниц и мониторинг телеметрии. Бюджет следует планировать не только под лицензии моделей, но и под зарплаты data‑engineer‑ов, DevOps‑поддержку и постоянный аудит качества – иначе рост количества документов превратит заявленную экономию в скрытый убыток.

Вывод прост: компании, которые учтут скрытые расходы на инфраструктуру, сохранят обещанную экономию до 30 % и избежат падения качества более чем на 40 % при масштабировании. Это меняет правила игры в юридическом AI – от «быстрого пилота» к устойчивой системе, где эффективность измеряется не только процентом снижения расходов, но и стабильностью точных правовых выводов.